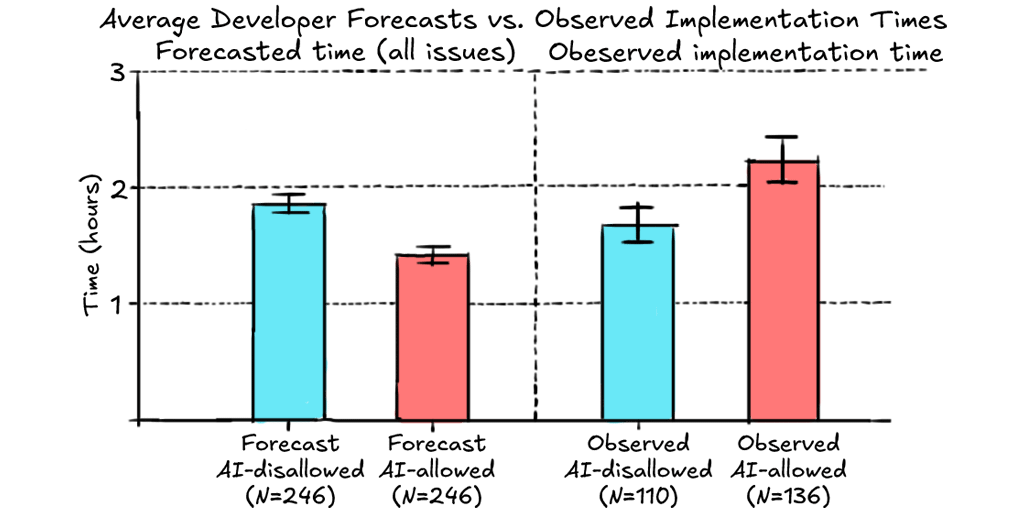

Research highlights that the use of artificial intelligence in coding slows down development by 19%. This is because seniors take longer to verify the code, it’s like following an overconfident junior. It is not the study that highlights the very little miraculous nature of the use of artificial intelligence in the way of working, to date we have no data that confirms a real “increase in productivity”.

https://medium.com/@fahimulhaq/tech-leaders-take-note-3-metr-study-takeaways-we-cant-ignore-9effb8f6399d

Posted by MasterPen6

19 Comments

Alla luce di questi studi, tu daresti ad un agente AI la libertà di controllare aspetti organizzativi della tua vita? Come prenotare in autonomia appuntamenti, viaggi o altre automazioni della tua vita quotidiana?

> ad oggi non abbiamo dati che confermano un vero “aumento di produttività”.

A parte che basterebbe chiederlo a chiunque, comunque, scientificamente, i primi due studi trovati in 2 minuti mentre bevo il caffè al bar:

[Research: Gen AI Makes People More Productive—and Less Motivated](https://hbr.org/2025/05/research-gen-ai-makes-people-more-productive-and-less-motivated)

> humans collaborating with gen AI achieve results that are both more efficient and often superior in quality

[The Impact of Generative AI on Work Productivity | St. Louis Fed](https://www.stlouisfed.org/on-the-economy/2025/feb/impact-generative-ai-work-productivity)

> The next figure shows that among workers who used generative AI in the previous week, 20.5% said that generative AI saved them four hours or more in that week, 20.1% reported three hours, 26.4% reported saving two hours, and 33.0% reported an hour or less. More-frequent users also reported greater time savings. Among workers who used generative AI every day in the previous week, 33.5% said it saved them four hours or more, compared with 11.5% of those who used it only one day in that week.

Mentre quello che hai citato è un preprint non revisionato: [[2507.09089] Measuring the Impact of Early-2025 AI on Experienced Open-Source Developer Productivity](https://arxiv.org/abs/2507.09089)

E comunque è ovvio che dipende dall’uso e dall’ambito.

La mia esperienza è che qualunque analisi sulla “AI” è di principio sbagliata.

Dipende dallo specifico LLM, dipende se ha accesso alla ad una base di codice dell’azienda o meno, e quanto è ampia e coerente, dipende da cosa si chiede e da come lo si chiede, dipende se sono statebimpostate delle regole di base.

Esempio banale, il prompt “Scrivi il codice che fa x” e “Scrivi il codice che fa x e assicurati che sia corretto” producono risultati diversi.

Ci sono ancora evidenze contrastanti

V. per esempio lo studio citato [qui](https://x.com/emollick/status/1988837620248412406?t=LR-rCELbJakvqW5-6uBJhQ&s=19), di questi giorni (relativo a Cursor):

When Cursor added agentic coding in 2024, adopters produced 39% more code merges, with no sign of a decrease in quality (revert rates were the same, bugs dropped) and no sign that the scope of the work shrank. Big impact.

Totally expected. They don’t trust the tools, don’t know how to use them properly, and are not really motivated to learn.

Real life debuff

“Il PC è stupido quanto lo è il suo utilizzatore.” L’IA non aumenta magicamente l’intelligenza di chi la sta utilizzando.

Io posso misurare solo me stesso e le persone con una certa seniority nel mio team…e questi dati non tornano per nulla.

Sto studio sono solo 16 persone estremamente senior su progetti vecchi e vasti che conoscono molto bene. C’e’ un altro studio da Mckinsey ( o come si chiama) in cui (nel 2023!!) Han calcolato un 50% di velocita’ in piu’.

AI e’ un tool ed e’ veramente grandioso su alcune cose. Non fare piccole modifiche chirurgiche che sai gia’ come fare.

Ma creare nuovi sistemi da 0 in aree in cui la tua conoscenza/esperienza e’ relativamente bassa.

Io in quei casi finisco le cose in tempi record ( giorni vs settimana)

dipende cosa intendi con AI Tools, copilot è da anni che è su visual studio e intelliJ ma viene usato come metodo predittivo per proporre autocompletamenti e blocchi di codice successivi, quel tipo di AI Tool migliora effettivamente la produttività, cose come lancia un prompt a caso e verifica invece no.

Boh io nella mia esperienza personale ho ridotto di tanto i tempi.

Mi aiuta anche a comprendere il codice legacy scritto da altre persone 15 anni fa.

L’altro giorno ho dovuto sistemare una app android legacy scritta da chissà chi 12 anni fa, e che era da rendere compatibile con le nuove api Android. Mi sarei sparato senza chatgpt.

Quando devo fare dei lavori noiosi in cui devo per forza di cose istanziare e usare decine di oggetti, mi basta premere tab e fa tutto da solo.

Le estensioni su vs code sono magiche.

Giusto 5 minuti fa stavo pensando “ok adesso devo fare un deinit”.

Premo invio, e copilot non mi propone da solo un deinit?

Edit: non capisco i downvoti. Ho espresso la mia esperienza personale.

Sono felice che la AI mi aiuti ad avere più tempo per me stesso, dato che ho la fortuna di lavorare per obiettivi.

Sono dell’idea che se non ve ne rendete conto o dite cose come “la AI ha allucinazioni”, non avete compreso COME usare le AI. Anche io all’inizio pensavo fossero inutili, ma una volta che capisci come chiedere le cose sono davvero utili.

Ad esempio, chiedere un pezzo alla volta aiuta tantissimo. Mostrare l’output desiderato aiuta tantissimo.

Chiedere di spiegare cosa fa del codice ultra contorto scritto da un integralista della programmazione 6 anni fa e che si divertiva a provare, senza ragione, ogni pattern possibile che leggeva sui giornali di informatica (sì purtroppo mi capita nel lavoro) aiuta tantissimo.

Mia esperienza personale. Per alcune cose veramente noiose trovo i vari GPT, Gemini, Claude veramente utili. Parlo di navigare in maniera interattiva su documentazioni di linguaggi, framework e librerie (il 90% delle volte fanno cagare e sono state scritte negli anni ’90) e legacy code. Posso fare domande, chiedere snippet e cose di questo tipo e mi accelera e mi rende più divertente il processo.

Per quanto riguarda la scrittura di software vero e proprio… Per ottenere buoni risultati, devo scrivere prompt lunghissimi e iper dettagliati, dargli il contesto giusto, copiargli il giusto codice da una miriade di file, spiegargli le convenzioni di stile, ecc. Tutto ciò è molto lungo e time consuming, a quel punto scrivo la feature direttamente da me. Non mi sembra ci sia risparmio di tempo.

Oltre al fatto che debuggare il codice scritto da un LLM è uguale a debuggare il legacy code scritto da altri, che è la parte più frustrante e deprimente di questo lavoro. Debuggare e ri-lavorare un codice che si è scritto linea per linea è decisamente più piacevole…

Io mi occupo di intelligenza artificiale a livello di ricerca, quindi scrivo codice e interagisco con questi tool tutto il giorno.

A mio avviso, copilot è estremamente utile per scrivere piccoli pezzetti di codice semplice e ripetitivo, anche perché mi accorgo subito se sta sbagliando. In questo mi fa risparmiare un sacco di tempo.

Al contrario, non mi farei mai scrivere sbobinature intere di codice da GPT o simili, perché è più il tempo che ci metto a verificare quello che hanno fatto e correggere gli errori che a scrivermi direttamente il codice da solo.

Siamo estremamente lontani dal sostituire una persona che sa quello che fa.

Penso dipenda anche dall’approccio. Se uno ha il controllo di quello che vuole scrivere spesso si può risparmiare tempo lasciando che l’LLM scriva un paio di righe o una funzione breve. Queste sono veloci da verificare e modificare se serve.

Lasciare che l’LLM faccia decisioni e risolva problemi al posto mio invece si è sempre rivelato un errore

Potrebbe non essere *ancora* efficace usarla. Ma nel prossimo futuro lo sarà sicuramente, e bisognerà essere in grado di usarla bene per non perdere vantaggio competitivo.

A chi ha dubbi sul fatto che l’AI faccia qualcosa male/in modo ridicolo, rimando sempre a vedere il video di Will Smith che mangia spaghetti di un paio di anni fa rispetto a quelli fatti con Sora oggi, oppure alle grasse risate che ingenuamente ci si faceva contando le dita delle persone generate da AI.

Probabile fossero esperti in sviluppo ma non in utilizzo dei tool AI

Sarò vecchio, ma ancora non ho capito come si possa usare l’AI nel proprio flusso di codice “primario”. Ho un framework, delle librerie utility magari fatte in casa, delle pratiche consolidate per quelle applicazioni su cui si lavora.

Come può una AI capire questo contesto? Magari il team è abituato a usare i Null object piuttosto che null-safe. Quale AI può intuirlo?

Un altro discorso invece sono le attività secondarie, tipo uno script da buttare giù al volo o una domanda troppo articolata per trovarla su StackOverflow. In quel caso è una mano santa.

Ma magari lo uso io nel modo sbagliato.

Utilizzo l’ai per scrivere codice in continuazione, funziona egregiamente.

Può fare un progetto complesso completamente? Ad oggi no, ad oggi!

Se gli circoscrivi il compito con attenzione, spiegando bene cosa vuoi al 90% funziona.

RemindMe! 5years

Cliccate, tra 5 anni ne riparliamo.